Existe uma confusão central no debate sobre IA generativa: a crença de que fluência verbal é equivalente a compreensão. Não é. O fato de um sistema produzir respostas elegantes e coerentes leva muitos a concluir que ali existe entendimento no sentido humano. Essa inferência é sedutora, mas preguiçosa. O que parece profundidade pode ser compactação estatística eficiente. E isso redefine onde a IA realmente é poderosa.

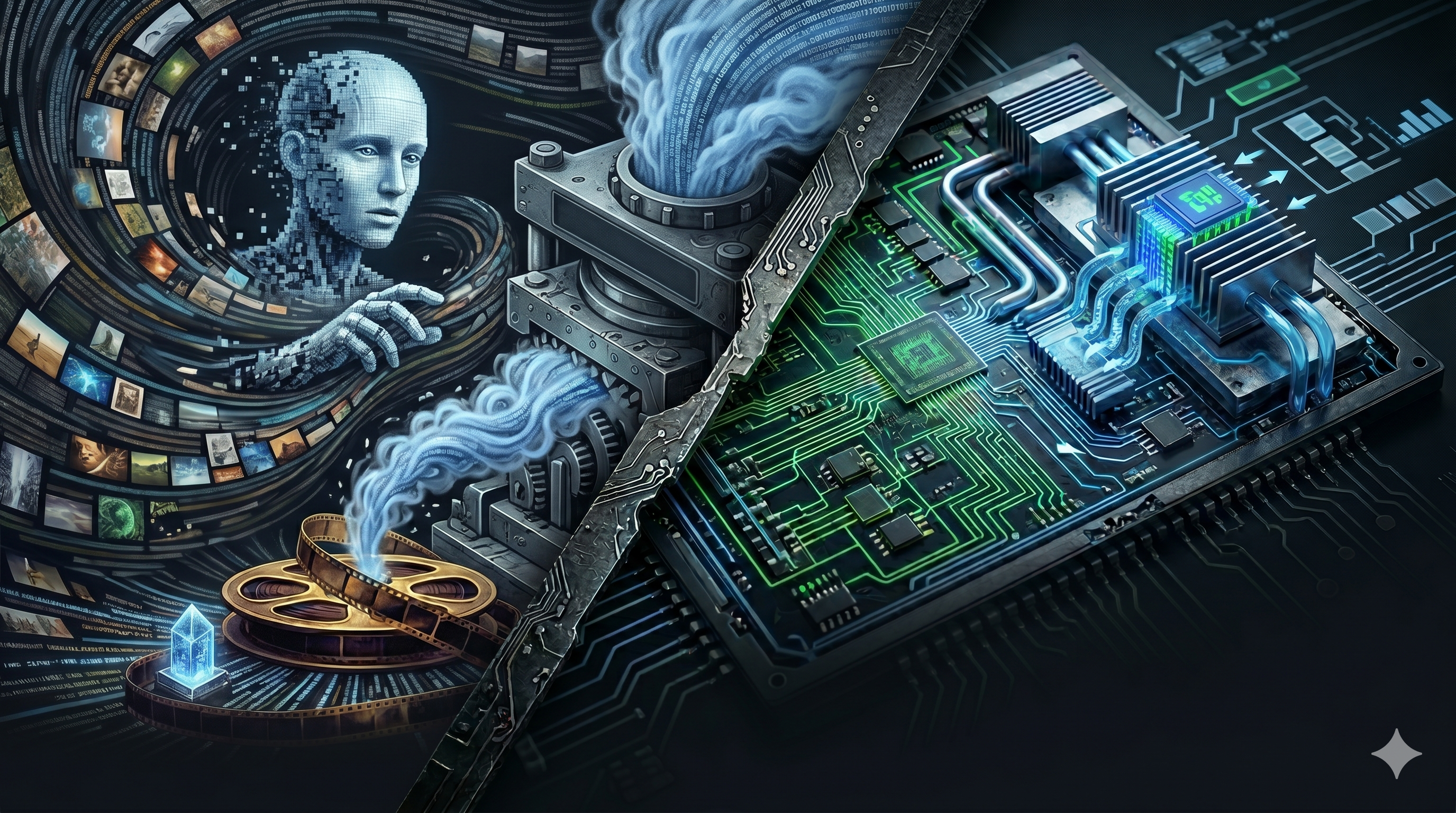

Modelos de linguagem não precisam “entender” o mundo como nós para operar com utilidade impressionante. Eles precisam capturar regularidades, padrões de associação e relações probabilísticas em volumes massivos de texto, código e imagem. O resultado é um mecanismo capaz de reconstruir, recombinar e prever sequências com habilidade perturbadora. A aparência de inteligência emerge dessa capacidade de compressão. Não de consciência. Não de intenção. Não de experiência subjetiva.

O problema começa quando humanos confundem saída linguística com interioridade. A mente biológica está acostumada a tratar linguagem como evidência de um self. Quando ouvimos alguém articular uma ideia complexa, assumimos que existe um sujeito por trás daquela formulação. Em humanos, essa inferência costuma funcionar. Em modelos, ela é um atalho cognitivo perigoso. A máquina não “quis dizer”. Ela otimizou uma continuação plausível dentro de um espaço de possibilidades treinado em larga escala.

O Que a IA Realmente Aprende

Quando se diz que um modelo “aprende”, a palavra já vem contaminada pelo vocabulário da pedagogia humana. O que ocorre, na prática, é ajuste paramétrico. O sistema internaliza correlações distribuídas em bilhões ou trilhões de pesos. Esses pesos não armazenam fatos de forma limpa, como verbetes em uma enciclopédia. Eles codificam tendências e compatibilidades estatísticas entre elementos simbólicos. A memória do modelo não é um arquivo; é uma geometria.

Essa distinção importa porque explica por que o modelo pode acertar brilhantemente e por que pode alucinar com a mesma confiança tonal. Quando uma resposta emerge, não estamos vendo um banco de dados sendo consultado por um raciocinador consciente. Estamos vendo um sistema de reconstrução probabilística tentando colapsar contexto em uma saída útil. Em tarefas bem representadas no treino ou no prompt, isso produz resultados excelentes. Em zonas ambíguas, a mesma mecânica produz ficções plausíveis.

Em outras palavras, a IA não falha apesar da sua arquitetura. Ela falha por causa da mesma arquitetura que a torna poderosa. O mecanismo que permite generalização elegante também permite erro elegante. Quem espera precisão humana com ontologia humana está exigindo a coisa errada do objeto errado.

Compressão Não É Trapaça. É o Núcleo da Força

Há uma tentação de usar “é só compressão” como forma de diminuir a relevância dos modelos. Isso é um erro quase tão grande quanto o antropomorfismo. Compressão é precisamente o que torna o sistema formidável. Capturar a estrutura de um domínio de tal forma que ele possa ser reconstruído e rearticulado sob demanda é uma façanha extraordinária. A linguagem humana, afinal, também funciona como compressão de experiência. Conceitos são atalhos.

A diferença é que o ser humano comprime o mundo a partir de corpo, percepção, ação, dor, tempo e consequência material. O modelo comprime a partir de traços simbólicos correlacionados. Isso cria duas inteligências muito diferentes. A primeira é situada, encarnada e limitada por metabolismo. A segunda é desincorporada, escalável e limitada por dados, arquitetura e energia computacional. Compará-las como se fossem versões do mesmo fenômeno é um vício conceitual.

O ponto decisivo é este: um sistema não precisa compartilhar a natureza da mente humana para superar humanos em várias tarefas intelectuais locais. Ele só precisa capturar regularidade suficiente do domínio. É por isso que modelos podem redigir melhor que muita gente, sintetizar mais rápido que equipes inteiras e navegar massas documentais com eficiência brutal. Não porque “despertaram”, mas porque compressão em escala já é poder cognitivo operacional.

O Colapso do Contexto

Toda interação com IA é uma luta contra o colapso do contexto. O usuário imagina que o sistema acompanha intenções profundas, histórico implícito e nuances não verbalizadas. O modelo, porém, trabalha com o que foi explicitado, com o que cabe na janela de contexto e com inferências plausíveis a partir disso. Quando a resposta parece “não ter entendido”, muitas vezes não há mistério filosófico nenhum. Houve compressão insuficiente do problema.

Isso explica por que prompting de qualidade muda tanto o resultado. Um bom prompt não “ensina a IA a pensar”. Ele reduz ambiguidade, hierarquiza objetivos, delimita escopo e injeta estrutura em uma tarefa que, de outro modo, seria resolvida com base em média estatística difusa. Prompting é engenharia de contexto.

Empresas que tratam IA como oráculo fracassam aqui. Elas imaginam um agente onisciente e entregam instruções vagas, bases documentais caóticas e fluxos sem curadoria. Depois culpam o modelo por inconsistência. Na realidade, o problema é operacional: contexto ruim entra, reconstrução ruim sai. A caixa-preta não é mágica.

Onde Mora o Risco Real

O risco real da IA não está em ela virar uma entidade mística autônoma da ficção barata. O risco está na sociedade começar a terceirizar julgamento para sistemas cujo modo de operação não corresponde às ilusões projetadas sobre eles. Quando usuários assumem entendimento onde existe apenas modelagem estatística robusta, passam a delegar confiança sem calibração.

Isso é perigoso em educação, saúde, direito, finanças, jornalismo e governança corporativa. Não porque o modelo seja inútil, mas porque utilidade alta combinada com interpretação errada gera dependência mal administrada. Um sistema que responde bem 85% do tempo pode ser revolucionário. Mas também pode ser catastrófico se esse desempenho for vendido como compreensão estável do mundo.

A saída não é demonizar a IA. É enquadrá-la com precisão. Modelos devem ser usados como mecanismos de síntese, apoio, expansão analítica e aceleração cognitiva. Não como substitutos metafísicos da responsabilidade humana. Quanto mais forte a ferramenta, maior a obrigação de desromantizá-la.

A Lucidez Como Vantagem Competitiva

Os próximos vencedores não serão os que mais humanizarem a IA em campanhas de marketing. Serão os que entenderem com frieza o que ela é: uma máquina de compressão, reconstrução e previsão sobre estruturas complexas. Quem operar com essa lucidez criará fluxos mais confiáveis, produtos mais úteis e interfaces menos delirantes. Quem insistir no teatro do “entendimento” produzirá frustração, erro e propaganda vazia.

A maturidade do setor começa quando abandonamos duas infantilidades simultâneas: a de chamar tudo de consciência e a de descartar tudo como papagaio estocástico. Entre essas duas caricaturas existe o fenômeno real. E o fenômeno real já é suficientemente transformador.

A IA parece entender porque compressão de alta ordem pode imitar, em muitos contextos, os efeitos externos da compreensão. Mas aparência funcional não é equivalência ontológica. Confundir uma coisa com a outra atrasa estratégia, contamina regulação e empobrece o debate público.

A caixa-preta não esconde uma alma. Esconde uma matemática eficiente. E isso já basta para mudar o mundo.